OpenAI官宣启动“下一代前沿模型”训练!训练参数预计将得到更大提升,或整合“文生视频”模型Sora

丝瓜网小编提示,记得把"OpenAI官宣启动“下一代前沿模型”训练!训练参数预计将得到更大提升,或整合“文生视频”模型Sora"分享给大家!

当地时间周二(5月28日),OpenAI宣布董事会成立安全与保障委员会。在这篇声明中,该公司同时宣称,已开始训练其“下一代前沿模型(next frontier model)”,并预计由此产生的系统将使我们在通往 AGI (注:通用人工智能)的道路上达到更高的能力水平。

OpenAI在该博客文章中表示,“虽然我们为打造和发布在能力和安全性方面都处于业界领先地位的模型而感到自豪,但在这个重要时刻,我们欢迎围绕这一问题展开激烈的讨论。”公司称,其成立的这个新委员会的目的就是来评估这项“新的前沿模型”可能带来的任何风险。

虽然目前外界普遍预计OpenAI所谓的“下一代前沿模型”就是GPT-5,但公司迄今未做过任何官方形式的表态。而根据OpenAI开发者体验主管罗曼·韦(Romain Huet)上周在巴黎的一次演讲,OpenAI下一代模型可能将被命名为“GPT-Next”。不过,也有外媒认为这实际上是Omni-2——一个更精致、训练参数更多、更强的GPT-4o增强版。

预计将不会使用GPT-5命名

OpenAI称,新成立的“安全与保障委员会”的首要任务“将是在未来90天内评估进一步发展OpenAI的流程和保障措施”。随后,OpenAI将在董事会审查后公开分享“采纳建议”的最新情况。这意味着OpenAI的董事会应该最迟在今年8月26日收到该委员会的建议。

图片来源:OpenAI

如果按照这样的时间表来计算,OpenAI最快可能在今年秋季发布所谓的“下一代前沿模型”。不过,《纽约时报》报道称,AI模型的训练可能需要数月甚至数年时间。训练完成后,AI公司通常还会再花几个月时间来测试该模型,并对其进行微调,之后才能供公众使用。这就意味着,OpenAI的下一代模型可能并不会在90天之后就发布。

在最近的国际人工智能首尔峰会期间发布的“安全更新(Security Update)”中,OpenAI也表示,在(其下一代模型)发布前,公司将花更多时间评估新模型的功能,这可以解释为什么没有具体的发布日期。

OpenAI并未明确提及训练中模型的名称,但外界第一时间猜测这一“前沿模型”就是GPT-5。

此前,OpenAI的基础模型一直遵循着明确的命名顺序,即GPT后以递增数字的形式变化。不过,需要注意的是,本月OpenAI发布的模型却命名为GPT-4o。

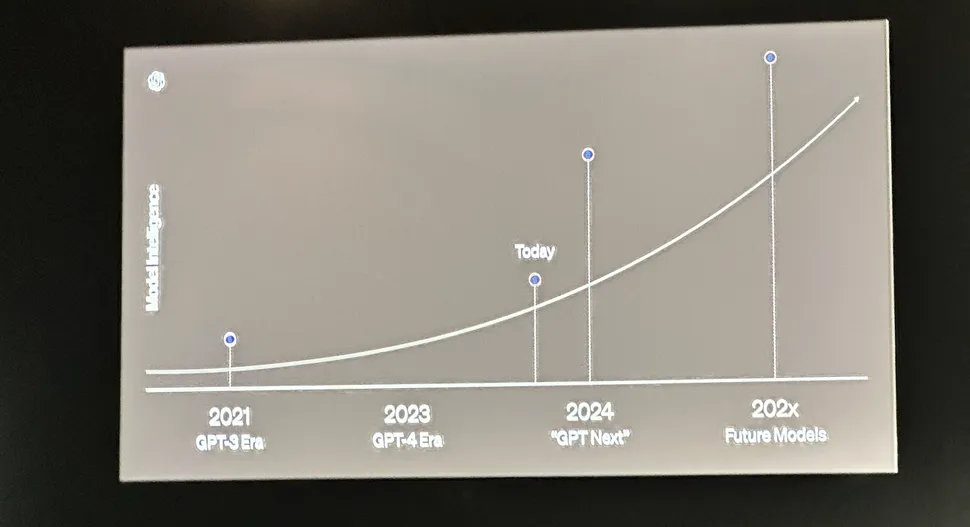

《每日经济新闻》记者发现,在当地时间5月22日巴黎举行的VivaTech会议上演示 ChatGPT Voice时,OpenAI开发者体验主管罗曼·韦展示了一张幻灯片,揭示了未来几年人工智能模型的潜在增长趋势和命名,其中并没有GPT-5。

罗曼·韦展示了GPT-3时代、GPT-4时代、GPT-Next和“未来的模型”,而“Today(今天)”就处于GPT-4时代和GPT-Next之间。这似乎意味着,OpenAI推出的下一代模型或将命名为GPT-Next,但有外媒认为这实际上是Omni-2——一个更精致、训练参数更多、更强的GPT-4o增强版。

而且,罗曼·韦在演讲中也表示,在未来几个月或者说今年,人们将看到更多类型的OpenAI模型,而不仅仅是ChatGPT一种模型。

图片来源:OpenAI

迭代趋势预示下一代模型将整合Sora

福布斯报道称,OpenAI所谓的“下一代前沿模型”可能会取代其领先的基础模型GPT-4,以及图像生成器、虚拟助手、搜索引擎和旗舰聊天机器人ChatGPT等强大的生成式AI工具。

科技媒体ZDNET报道称,按照过去的趋势,外界可以预期“下一代前沿模型”的反应会更加准确,因为它将接受更多数据的训练。模型训练的数据越多,该模型生成连贯、准确内容的能力就越强,从而也能拥有更好地性能。

例如,有研究称GPT-3.5是在1750亿个参数上训练的,而GPT-4的训练参数则已经达到1万亿。报道称,如果OpenAI“下一代前沿模型”发布,我们可能会看到该模型在训练参数上更大的飞跃。

而回顾OpenAI过往的基础模型,从GPT-3.5到最新的GPT-4o,可以看到,随着模型的升级,产品的迭代已经让其变得更加智能,包括价格、响应速度、上下文长度等等。要知道,GPT-3.5只能输入和输出文本,而到GPT-4 Turbo时,已经可以通过文字和图像的输入以获得文本的输出。GPT-4o更是展示了更强大的能力,不仅能处理文本,还能创建图像内容,并以高度对话化的语音方式回答问题和响应指令。

ZDNET报道称,按照OpenAI基础模型这样的迭代趋势,“下一代前沿模型”或将拥有输出视频的能力。今年2月,OpenAI发布了“文生视频”模型Sora,这可能会被整合到“下一代前沿模型”中以输出视频。

OpenAI的目标是在超越竞争对手的同时,更快地推进AI技术,同时也安抚那些认为该技术越来越危险、助长虚假信息传播、取代工作岗位甚至威胁人类生存的批评者。虽然OpenAI在周二的博客文章中称,预期其“新前沿模型”将使我们在通往AGI的道路上达到更高的能力水平,这是一种能够理解、学习和执行人类可以执行的任何智力任务的 AI 形式。不过,专家们对 AGI 的可行性以及何时可能实现存在分歧。被誉为 AI 教父的 Geoffrey Hinton 估计,可能需要 20 年才能发展出 AGI。英伟达CEO黄仁勋则预测称,AI会在五年内通过人类测试,AGI将很快到来。